Was sind Large Language Models (LLMs)?

Large Language Models (LLMs) sind eine hochmoderne Entwicklung im Bereich der natürlichen Sprachverarbeitung (NLP), die darauf abzielt, menschliche Sprache zu verstehen und zu erzeugen. LLMs sind fortschrittliche KI-Modelle, die auf riesigen Mengen von Textdaten trainiert wurden. Sie sind in der Lage, sprachliche Muster zu erkennen, den Kontext zu verstehen und kohärente und kontextbezogene Antworten zu geben. Während NLP die grundlegenden Techniken bereitstellt, mit denen sich Maschinen mit Sprache auseinandersetzen können, stellen LLMs einen spezialisierten Ansatz dar, der die Fähigkeit von Maschinen, ein menschenähnliches Sprachverständnis und eine menschenähnliche Spracherzeugung nachzuahmen, erheblich verbessert hat...

Was sind einige aktuelle LLMs?

LLMs stellen die Grenze der natürlichen Sprachverarbeitung dar, und mehrere Modelle dominieren derzeit den Raum, darunter Googles Gemini, Metas Galactica und Llama, OpenAIs GPT-Serie und andere wie Falcon 40B und Phi-1. Mit unterschiedlichen Architekturen und Parametergrößen zeichnen sich diese Modelle durch Aufgaben aus, die von der Beantwortung von Anfragen bis zur Generierung kohärenter und kontextbezogener Texte über lange Passagen reichen.

BERT, eingeführt von Google, legte mit seiner Transformator-basierten Architektur den Grundstein. Meta's Galactica, ein neuer Teilnehmer, zielt dagegen ausdrücklich auf die wissenschaftliche Gemeinschaft ab und wird wegen der Erzeugung irreführender "Halluzinationen", die tiefgreifende Auswirkungen auf den wissenschaftlichen Bereich haben könnten, kritisiert. Die GPT-Serien von OpenAI, insbesondere GPT-3 und GPT-4, sind bahnbrechend in ihrer Kapazität. Letztere soll Gerüchten zufolge über 170 Billionen Parameter enthalten und sowohl Text als auch Bilder verarbeiten können. Die Fähigkeiten dieses Modells führten zu Spekulationen über die Annäherung an die künstliche allgemeine Intelligenz (AGI), eine theoretische Fähigkeit von Maschinen, die der menschlichen Intelligenz gleichkommt oder sie übertrifft.

Die Herausforderungen bleiben jedoch bestehen. Der schiere Umfang und die Komplexität dieser Modelle können zu unvorhersehbaren Ergebnissen führen, und ihre immensen Anforderungen an die Ausbildung geben Anlass zur Sorge über die ökologische Nachhaltigkeit und verzerrte Ergebnisse.

Trotz aller Bedenken verspricht die Entwicklung der LLMs jedoch Fortschritte in verschiedenen Bereichen - von banalen Aufgaben wie der Verbesserung der Websuche bis hin zu kritischen Bereichen wie der medizinischen Forschung und der Cybersicherheit. Während das Feld voranschreitet, bleibt das Gleichgewicht zwischen Potenzial und Vorsicht von größter Bedeutung.

Wie LLMs funktionieren

Um sich beim Verstehen und Erzeugen von menschenähnlicher Sprache auszuzeichnen, verwenden LLMs eine Kombination aus neuronalen Netzwerken, umfangreichen Trainingsdatensätzen und einer Architektur namens Transformers.

Neuronale Netzwerke

Das Herzstück großer Sprachmodelle sind neuronale Netzwerke mit mehreren Schichten, die als Deep Learning-Modelle bekannt sind. Diese Netzwerke bestehen aus miteinander verbundenen Knoten oder Neuronen, die in der Trainingsphase lernen, Muster in den Eingabedaten zu erkennen. LLMs werden auf einem riesigen Textkorpus trainiert, der verschiedene Quellen wie Websites, Bücher und Artikel umfasst, so dass sie Grammatik, Syntax, Semantik und kontextbezogene Informationen lernen können.

Auf der Grundlage von Algorithmen, die darauf ausgelegt sind, Muster zu erkennen, interpretieren neuronale Netzwerke sensorische Daten durch eine Art Maschinenwahrnehmung, Etikettierung oder Clustering des rohen Inputs. Die Architekturen neuronaler Netzwerke reichen von einfachen Feedforward-Netzwerken, bei denen die Verbindungen zwischen den Knoten keinen Kreislauf bilden, bis hin zu komplexen Strukturen mit ausgeklügelten Schichten und mehreren Feedback-Schleifen.

Convolutional Neural Networks (CNNs): Diese sind besonders effektiv bei der Verarbeitung von Daten mit einer gitterartigen Topologie. Beispiele hierfür sind Bilddaten, die man sich als 2D-Gitter aus Pixeln vorstellen kann.

Rekurrente Neuronale Netzwerke (RNNs): Diese sind für sequentielle Daten wie Text und Sprache geeignet. Die Ausgabe in jedem Schritt hängt von den vorangegangenen Berechnungen und einer bestimmten Art von Erinnerung an das bisher Verarbeitete ab.

Transformatoren

Die Transformator-Architektur ist eine entscheidende Komponente von LLMs, die von Vaswani et al. 2017 vorgestellt wurde. Transformers beheben die Einschränkungen früherer Sequenzmodelle wie RNNs und LSTMs, die mit weitreichenden Abhängigkeiten und Parallelisierung zu kämpfen hatten. Transformers verwenden einen Mechanismus, der als Selbstaufmerksamkeit bezeichnet wird und der es dem Modell ermöglicht, die Bedeutung verschiedener Wörter im Eingabekontext zu gewichten und Beziehungen zwischen ihnen zu erfassen, unabhängig von ihrem Abstand in der Sequenz.

Tokenisierung

Die Tokenisierung ist der erste Schritt bei der Verarbeitung von Text mit einem LLM. Der eingegebene Text wird in kleinere Einheiten, so genannte Tokens, zerlegt, die dann in numerische Darstellungen (Vektoren) umgewandelt werden, die das neuronale Netzwerk verarbeiten kann. Während des Trainings lernt das Modell, auf der Grundlage der Eingabe-Token und ihrer Beziehungen kontextuell passende Ausgabe-Token zu erzeugen.

Beim Trainingsprozess werden die Gewichte der Verbindungen des neuronalen Netzwerks durch eine Technik namens Backpropagation angepasst. Indem es die Differenz zwischen den Vorhersagen des Modells und den tatsächlichen Ziel-Token in den Trainingsdaten minimiert, lernt das Modell, genauere und kohärentere Sprache zu erzeugen.

Einmal trainiert, können große Sprachmodelle für bestimmte Aufgaben oder Bereiche, wie z.B. Stimmungsanalyse, Zusammenfassungen oder Fragenbeantwortung, feinabgestimmt werden, indem das Modell über einen kurzen Zeitraum auf einem kleineren, aufgabenspezifischen Datensatz trainiert wird. Dieser Prozess ermöglicht es dem LLM, sein generalisiertes Sprachverständnis an die Nuancen und Anforderungen der Zielaufgabe anzupassen.

Verbundener Artikel: Künstliche Intelligenz erklärt

Vorteile von LLMs

Große Sprachmodelle bieten eine Vielzahl von Vorteilen, darunter:

- Fortgeschrittenes Verstehen natürlicher Sprache: LLMs können den Kontext und die Nuancen in der Sprache verstehen, wodurch ihre Antworten relevanter und menschlicher werden.

- Vielseitigkeit: LLMs können auf verschiedene Aufgaben angewendet werden, wie z.B. Texterstellung, Zusammenfassung, Übersetzung und Beantwortung von Fragen, ohne dass ein aufgabenspezifisches Training erforderlich ist.

- Übersetzung: LLMs, die in mehreren Sprachen ausgebildet sind, können effektiv zwischen diesen Sprachen übersetzen. Einige Theorien besagen, dass sie anhand von Mustern sogar Bedeutungen aus unbekannten oder verlorenen Sprachen ableiten könnten.

- Automatisieren Sie alltägliche Aufgaben: LLMs können textbezogene Aufgaben wie Zusammenfassungen, Neuformulierungen und die Erstellung von Inhalten übernehmen, was besonders für Unternehmen und Inhaltsersteller nützlich sein kann.

- Aufstrebende Fähigkeiten: Aufgrund der riesigen Datenmengen, mit denen sie trainiert werden, können LLMs unerwartete, aber beeindruckende Fähigkeiten zeigen, wie z.B. mehrstufiges Rechnen, Beantworten komplexer Fragen und Erstellen von Gedankenketten-Eingaben.

- Fehlersuche und Kodierung: Im Bereich der Cybersicherheit können LLMs beim Schreiben und Debuggen von Code schneller helfen als herkömmliche Methoden.

- Analyse von Bedrohungsmustern: Im Bereich der Cybersicherheit können LLMs Muster erkennen, die mit Advanced Persistent Threats (APTs) zusammenhängen, und so die Zuordnung von Vorfällen und die Schadensbegrenzung in Echtzeit unterstützen.

- Antwort-Automatisierung: In Security Operations Centers können LLMs Antworten automatisieren, Skripte und Tools generieren und bei der Erstellung von Berichten helfen, so dass Sicherheitsexperten weniger Zeit für Routineaufgaben aufwenden müssen.

Trotz dieser Vorteile dürfen Sie nicht vergessen, dass LLMs auch Nachteile und ethische Überlegungen mit sich bringen, die es zu beachten gilt.

Herausforderungen mit LLMs

Es ist zwar leicht, sich von den Vorteilen der beeindruckenden sprachlichen Fähigkeiten eines LLM zu überzeugen, aber Organisationen müssen sich auch der potenziellen Herausforderungen bewusst sein, die damit verbunden sind, und darauf vorbereitet sein.

Operative Herausforderungen

- Halluzination: LLMs können manchmal bizarre, unwahre Ausgaben produzieren oder den Eindruck von Empfindungsvermögen erwecken. Diese Ausgaben basieren nicht auf den Trainingsdaten des Modells und werden als "Halluzinationen" bezeichnet.

- Voreingenommenheit: Wenn ein LLM auf voreingenommenen Daten trainiert wird, können seine Ergebnisse diskriminierend oder voreingenommen gegenüber bestimmten Gruppen, Ethnien oder Klassen sein. Auch nach dem Training können sich Vorurteile aufgrund von Benutzerinteraktionen weiterentwickeln. Microsofts Tay ist ein berüchtigtes Beispiel dafür, wie sich Voreingenommenheit manifestieren und eskalieren kann.

- Glitch Tokens oder gegnerische Beispiele: Es handelt sich dabei um spezielle Eingaben, die das Modell dazu bringen, fehlerhafte oder irreführende Ergebnisse zu produzieren, was zu einer "Fehlfunktion" des Modells führt.

- Mangelnde Erklärbarkeit: Es kann schwierig sein, zu verstehen, wie LLMs bestimmte Entscheidungen treffen oder bestimmte Ergebnisse erzeugen, was die Fehlersuche und -behebung erschwert.

- Übermäßiges Vertrauen: Da LLMs immer mehr in verschiedene Sektoren integriert werden, besteht die Gefahr, dass man sich zu sehr auf sie verlässt und menschliche Expertise und Intuition in den Hintergrund treten.

LLM Anwendungsfälle & Bereitstellungsoptionen

LLMs bieten Organisationen eine Reihe von optionalen Implementierungsmustern, die sich jeweils auf eine Reihe von Tools und die damit verbundenen Sicherheitsimplikationen stützen.

Verwendung von vortrainierten LLMs

Cloud-Anbieter wie OpenAI und Anthropic bieten API-Zugang zu leistungsstarken LLMs, die sie verwalten und sichern. Organisationen können diese APIs nutzen, um LLM-Funktionen in ihre Anwendungen einzubinden, ohne die zugrunde liegende Infrastruktur verwalten zu müssen.

Alternativ können Open-Source-LLMs wie LLaMa von Meta auf der eigenen Infrastruktur einer Organisation ausgeführt werden, was mehr Kontrolle und Anpassungsmöglichkeiten bietet. Nachteilig ist, dass Open-Source-LLMs erhebliche Rechenressourcen und KI-Kenntnisse erfordern, um sie sicher zu implementieren und zu pflegen.

LLM-Bereitstellungsmodelle

- API-basiertes SaaS: Die Infrastruktur wird vom LLM-Entwickler (z.B. OpenAI) bereitgestellt und verwaltet und über eine öffentliche API provisioniert.

- CSP-verwaltet: Der LLM wird auf einer von Cloud-Hyperscalern bereitgestellten Infrastruktur bereitgestellt und kann in einer privaten oder öffentlichen Cloud, wie Azure, OpenAI und Amazon Bedrock, laufen.

- Selbstverwaltet: Der LLM wird auf der eigenen Infrastruktur des Unternehmens bereitgestellt, was nur für Open-Source- oder selbst entwickelte Modelle relevant ist.

Vorgeschulte LLMs bieten verschiedene Funktionalitäten - Inhaltserstellung, Chatbots, Stimmungsanalyse, Sprachübersetzung und Code-Assistenten. Ein E-Commerce-Unternehmen könnte ein LLM verwenden, um Produktbeschreibungen zu erstellen, während ein Softwareentwicklungsunternehmen einen LLM-gestützten Programmierassistenten einsetzen könnte, um die Produktivität der Programmierer zu steigern.

Auswirkungen auf die Sicherheit im Zusammenhang mit vortrainierten LLMs

Die Verfügbarkeit von leicht zugänglichen Cloud-APIs und Open-Source-Modellen hat die Hürden für das Hinzufügen fortgeschrittener KI-Sprachfunktionen zu Anwendungen drastisch gesenkt. Entwickler können jetzt LLMs in ihre Software einbauen, ohne tiefgreifende Kenntnisse in KI und ML zu benötigen. Dies beschleunigt zwar die Innovation, erhöht aber auch das Risiko von Schatten-KI-Projekten, bei denen es an angemessener Sicherheit und Compliance-Überwachung mangelt. Entwicklungsteams experimentieren unterdessen möglicherweise mit LLMs, ohne den Datenschutz, die Modellverwaltungund Fragen der Output-Kontrolle vollständig zu berücksichtigen.

Feinabstimmung und Retrieval-Augmented Generation (RAG)

Um LLMs für bestimmte Anwendungen anzupassen, können Organisationen eine Feinabstimmung an kleineren Datensätzen vornehmen, die sich auf die gewünschte Aufgabe beziehen, oder RAG implementieren, was die Integration von LLMs mit Wissensdatenbanken für die Beantwortung von Fragen und die Zusammenfassung von Inhalten beinhaltet.

Zu den Anwendungsfällen gehören spezialisierte KI-Assistenten mit Zugriff auf interne Daten (z. B. für den Kundensupport, die Personalabteilung oder den IT-Helpdesk) und Q&A-Apps (z. B. für Dokumentation, Coderepositorys oder Schulungsmaterialien). Der Chatbot eines Telekommunikationsunternehmens könnte beispielsweise anhand von Produktdokumentationen, FAQs oder früheren Support-Interaktionen optimiert werden, um Kunden bei technischen Fragen und der Kontoverwaltung besser zu unterstützen.

Auswirkungen auf die Sicherheit im Zusammenhang mit Feinabstimmung und RAG

Feinabstimmung und RAG ermöglichen es Organisationen, LLMs an ihren spezifischen Bereich und ihre Daten anzupassen und so gezieltere und genauere Ergebnisse zu erzielen. Dieser Anpassungsprozess beinhaltet jedoch häufig, dass das Modell während des Trainings sensiblen internen Informationen ausgesetzt wird. Strenge Data-Governance-Praktiken sind erforderlich, um sicherzustellen, dass nur autorisierte Daten für die Feinabstimmung verwendet werden und dass die daraus resultierenden Modelle sicher sind.

Model Ausbildung

Einige große Technologieunternehmen und Forschungseinrichtungen investieren in die Ausbildung ihrer eigenen LLMs. Dies ist zwar ein sehr ressourcenintensiver Prozess, der enorme Rechenleistung und Datensätze erfordert, aber er gibt Organisationen die volle Kontrolle über die Modellarchitektur, die Trainingsdaten und den Optimierungsprozess. Darüber hinaus behält die Organisation die vollen Rechte am geistigen Eigentum der entstandenen Modelle.

Das Training von Modellen kann zu fortschrittlichen Anwendungen wie der Entdeckung von Medikamenten, Materialwissenschaften oder autonomen Systemen führen. Eine Organisation des Gesundheitswesens könnte beispielsweise ein Modell entwickeln, das bei der Diagnose von Krankheiten anhand von Krankenakten und Bilddaten hilft.

Auswirkungen auf die Sicherheit im Zusammenhang mit der Modellschulung

Die Schulung benutzerdefinierter LLMs wirft schwierige Fragen darüber auf, wie die Nachvollziehbarkeit und Überprüfbarkeit des Modellverhaltens beim Umgang mit komplexen Blackbox-Modellen gewährleistet werden kann. Der Trainingsprozess selbst verbraucht enorme Rechenressourcen, so dass eine starke Isolierung und Zugangskontrolle der Trainingsumgebung erforderlich ist, um Missbrauch oder Störungen zu verhindern. Zunächst muss die Organisation eine hochleistungsfähige Computing-Infrastruktur aufbauen und riesige Datensätze sorgfältig kuratieren, was neue Sicherheitsherausforderungen mit sich bringen kann.

LLM Sicherheitsbedenken

Ein Hauptproblem bei der Bereitstellung großer Sprachmodelle in Unternehmen ist die mögliche Einbeziehung sensibler Daten beim Training. Sobald Daten in diese Modelle eingeflossen sind, wird es schwierig, genau zu erkennen, welche Informationen in die Modelle eingespeist wurden. Dieser Mangel an Transparenz kann problematisch sein, wenn man die unzähligen Datenquellen bedenkt, die für die Ausbildung genutzt werden, und die verschiedenen Personen, die auf diese Daten zugreifen könnten.

Um die unbeabsichtigte Offenlegung vertraulicher Informationen zu verhindern, ist es von entscheidender Bedeutung, dass Sie Einblick in die Datenquellen haben und streng kontrollieren können, wer Zugang zu ihnen hat.

Eine weitere Sorge ist der mögliche Missbrauch von LLMs bei Cyberangriffen. Böswillige Akteure können LLMs nutzen, um überzeugende Phishing-E-Mails zu verfassen, um Personen zu täuschen und unbefugten Zugriff auf sensible Daten zu erhalten. Diese Methode, die als Social Engineering bekannt ist, hat das Potenzial, überzeugende und trügerische Inhalte zu erstellen, was die Herausforderungen des Datenschutzes noch vergrößert.

Ohne strenge Zugangskontrollen und Sicherheitsvorkehrungen steigt das Risiko erheblicher Datenverletzungen . Böswillige Akteure erhalten so die Möglichkeit, mit Leichtigkeit Fehlinformationen, Propaganda oder andere schädliche Inhalte zu verbreiten.

LLMs haben zwar nahezu unbegrenzte positive Anwendungsmöglichkeiten, aber sie bergen auch das Potenzial, bösartigen Code zu erzeugen, der herkömmliche Filter zur Verhinderung solchen Verhaltens umgeht. Diese Anfälligkeit könnte zu einer neuen Ära von Cyberbedrohungen führen, bei denen Datenlecks nicht nur dazu dienen, Informationen zu stehlen, sondern gefährliche Inhalte und Codes zu erzeugen.

Wenn sie manipuliert werden, können LLMs beispielsweise bösartige Software, Skripte oder Tools erzeugen, die ganze Systeme gefährden können. Ihr Potenzial für "Belohnungs-Hacking" schlägt im Bereich der Cybersicherheit Alarm, denn es könnten unbeabsichtigte Methoden zur Erfüllung ihrer Ziele entdeckt werden, die zu einem unbeabsichtigten Zugriff auf oder zur Entnahme von sensiblen Datenführen.

Je mehr wir uns auf LLM-Anwendungen verlassen, desto wichtiger wird es für Organisationen und Einzelpersonen, wachsam gegenüber diesen neuen Bedrohungen zu sein und darauf vorbereitet zu sein, ihre Daten zu jeder Zeit zu schützen.

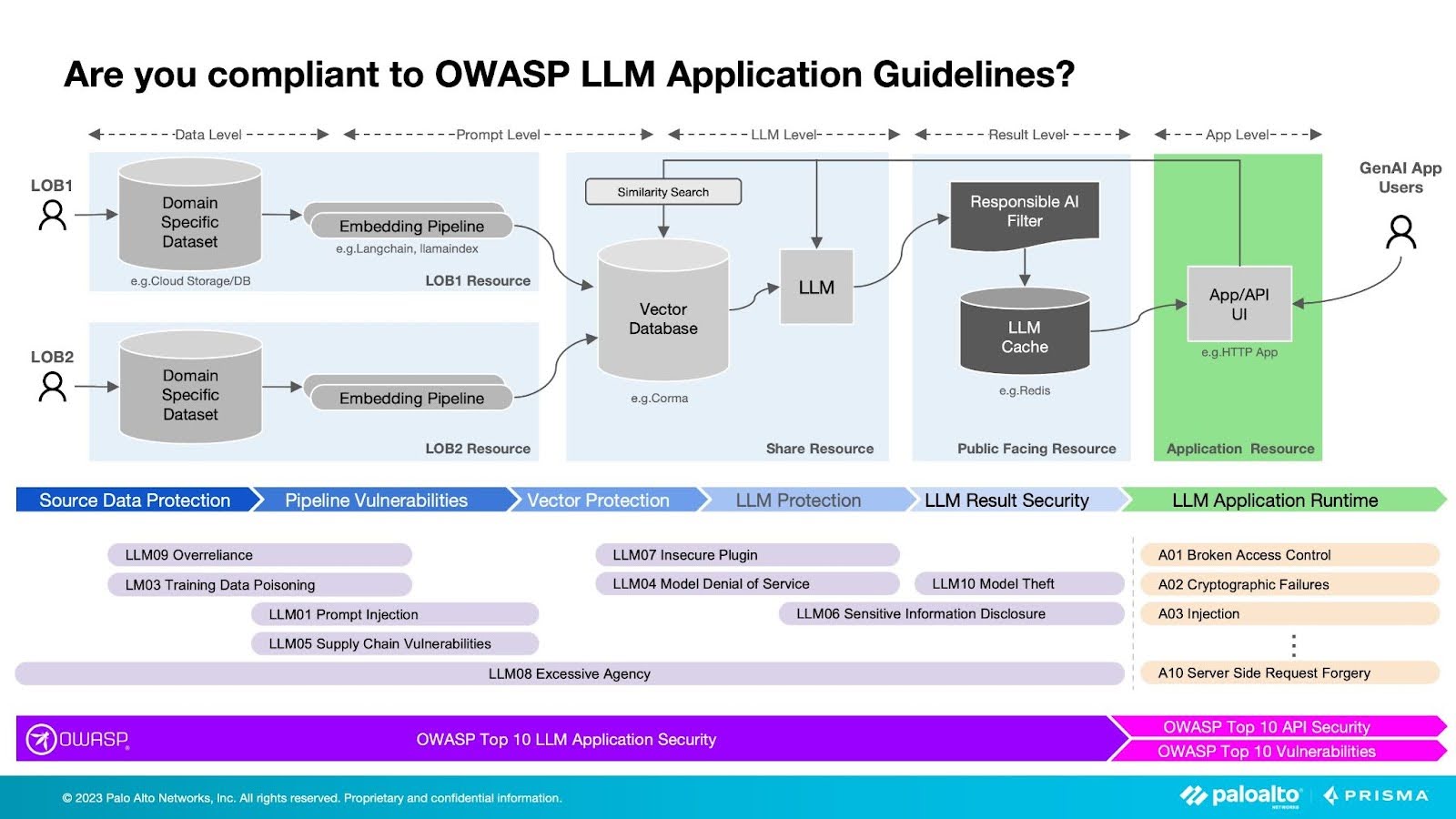

Abbildung 1: Schutz von LLMs vor den wichtigsten OWASP-Sicherheitsrisiken

Die OWASP Top Ten: LLM Sicherheitsrisiken

Konventionelle Anwendungsschwachstellen stellen eine neue Art von Sicherheitsrisiken innerhalb von LLMs dar. Aber wie es sich gehört, hat OWASP die OWASP Top Ten LLM Security Risks rechtzeitig veröffentlicht und damit Entwickler auf neue Mechanismen und die Notwendigkeit aufmerksam gemacht, traditionelle Abhilfestrategien für ihre Anwendungen, die LLMs verwenden, anzupassen.

LLM01: Prompte Injektion

Prompt Injection kann ein großes Sprachmodell durch hinterhältige Eingaben manipulieren und das LLM dazu bringen, die Absichten des Angreifers auszuführen. Bei direkten Injektionen überschreibt der Bösewicht die Eingabeaufforderungen des Systems. Bei indirekten Prompt-Injektionen manipulieren Angreifer Eingaben aus externen Quellen. Beide Methoden können zu Datenexfiltration, Social Engineering und anderen Problemen führen.

LLM02: Unsichere Handhabung der Ausgabe

Die unsichere Verarbeitung von Ausgaben ist eine Schwachstelle, die auftritt, wenn eine LLM-Ausgabe ohne Prüfung akzeptiert wird und dadurch Backend-Systeme offengelegt werden. Sie entsteht, wenn eine nachgelagerte Komponente die LLM-Ausgabe blind akzeptiert, ohne sie effektiv zu überprüfen. Missbrauch kann zu Cross-Site Scripting (XSS) und Cross-Site Request Forgery (CSRF) in Webbrowsern sowie zu Server-Side Request Forgery (SSRF), Privilegienerweiterung und Remotecode-Ausführung auf Backend-Systemen führen.

LLM03: Vergiftung von Trainingsdaten

Trainingsdatenvergiftung tritt auf, wenn LLM-Trainingsdaten über Common Crawl, WebText, OpenWebText, Bücher und andere Quellen manipuliert werden. Durch die Manipulation werden Hintertüren, Schwachstellen oder Verzerrungen eingeführt, die die Sicherheit des LLM gefährden und zu Leistungseinbußen, nachgelagerter Softwareausbeutung und Rufschädigung führen.

LLM04: Modell Denial of Service

Model Denial of Service tritt auf, wenn ein Angreifer eine LLM ausnutzt, um einen ressourcenintensiven Vorgang auszulösen, was zu einer Verschlechterung des Dienstes und erhöhten Kosten führt. Diese Anfälligkeit wird durch die anspruchsvolle Natur der LLMs und die Unvorhersehbarkeit der Benutzereingaben noch verstärkt. In einem modellhaften Denial-of-Service-Szenario greift ein Angreifer ein LLM in einer Weise an, die eine unverhältnismäßig große Menge an Ressourcen beansprucht, was zu einer Verschlechterung der Servicequalität sowohl für den Angreifer als auch für andere Benutzer führt und möglicherweise erhebliche Ressourcenausgaben verursacht.

LLM05: Schwachstellen in der Lieferkette

Schwachstellen in der Lieferkette von LLMs können Trainingsdaten, ML-Modelle und Bereitstellungsplattformen kompromittieren und zu Sicherheitsverletzungen oder kompletten Systemausfällen führen. Anfällige Komponenten oder Dienste können aus vergifteten Trainingsdaten, unsicheren Plugins, veralteter Software oder anfälligen vortrainierten Modellen entstehen.

LLM06: Offenlegung sensibler Informationen

LLM-Anwendungen können sensible Daten, vertrauliche Informationen und geschützte Algorithmen preisgeben, was zu unberechtigtem Zugriff, Diebstahl von geistigem Eigentum und Datenverletzungenführen kann. Um diese Risiken zu minimieren, sollten LLM-Anwendungen Daten bereinigen, angemessene strenge Benutzerrichtlinien implementieren und die vom LLM zurückgegebenen Datentypen einschränken.

LLM07: Unsicheres Plugin-Design

Plugins können unsichere Eingaben und eine unzureichende Zugriffskontrolleenthalten, was sie anfällig für bösartige Anfragen macht, die zu Datenexfiltration, Remotecodeausführung und Privilegienerweiterung führen können. Entwickler müssen strenge Richtlinien für parametrisierte Eingaben und sichere Zugriffskontrolle befolgen, um einen Missbrauch zu verhindern.

LLM08: Exzessive Agentur

Übermäßiges Handeln bezieht sich auf LLM-basierte Systeme, die Aktionen durchführen, die zu unbeabsichtigten Konsequenzen führen. Die Anfälligkeit ergibt sich daraus, dass dem LLM zu viel Autonomie, Überfunktionalität oder übermäßige Berechtigungen gewährt werden. Die Entwickler sollten die Plugin-Funktionen auf das absolut Notwendige beschränken. Sie sollten auch die Benutzerautorisierung nachverfolgen, für alle Aktionen eine menschliche Genehmigung verlangen und die Autorisierung in nachgelagerten Systemen implementieren.

LLM09: Übermäßiges Vertrauen

Ein LLM kann unangemessene Inhalte generieren, wenn menschliche Benutzer oder Systeme sich übermäßig auf den LLM verlassen, ohne ihn angemessen zu überwachen. Zu den möglichen Folgen von LLM09 gehören Fehlinformationen, Sicherheitslücken und rechtliche Probleme.

LLM10: Modell Diebstahl

Der Diebstahl von LLM-Modellen beinhaltet den unbefugten Zugriff, das Kopieren oder die Exfiltration von geschützten LLMs. Modelldiebstahl führt zu finanziellen Verlusten und dem Verlust von Wettbewerbsvorteilen sowie zu Rufschädigung und unbefugtem Zugriff auf sensible Daten. Organisationen müssen strenge Sicherheitsmaßnahmen ergreifen, um ihre geschützten LLMs zu schützen.

FAQs zum großen Sprachmodell

NLP ist ein Teilgebiet der KI und der Linguistik, das sich darauf konzentriert, Computer in die Lage zu versetzen, menschliche Sprache zu verstehen, zu interpretieren und zu erzeugen. NLP umfasst ein breites Spektrum an Aufgaben, darunter Sentimentanalyse, maschinelle Übersetzung, Textzusammenfassung und Named Entity Recognition. NLP-Techniken umfassen in der Regel Computeralgorithmen, statistische Modellierung und maschinelles Lernen zur Verarbeitung und Analyse von Textdaten.

Ein LLM ist eine Art von Deep-Learning-Modell, insbesondere ein neuronales Netzwerk, das für die Bearbeitung von NLP-Aufgaben im großen Maßstab entwickelt wurde. LLMs, wie GPT-3 und BERT, werden auf riesigen Mengen von Textdaten trainiert, um komplexe Sprachmuster, Grammatik und Semantik zu lernen. Diese Modelle nutzen eine Technik, die als Transformator-Architektur bezeichnet wird und es ihnen ermöglicht, weitreichende Abhängigkeiten und kontextbezogene Informationen in der Sprache zu erfassen.

Der Hauptunterschied zwischen NLP und LLM besteht darin, dass NLP ein breiteres Feld ist, das verschiedene Techniken und Ansätze zur Verarbeitung menschlicher Sprache umfasst, während LLM eine spezielle Art von neuronalem Netzwerkmodell ist, das für fortgeschrittene NLP-Aufgaben entwickelt wurde. LLMs stellen einen hochmodernen Ansatz im NLP-Bereich dar, der im Vergleich zu traditionellen NLP-Methoden eine verbesserte Leistung und Fähigkeiten beim Verstehen und Erzeugen menschenähnlicher Sprache bietet.

Generative adversarische Netzwerke (GANs) sind eine Klasse von Modellen des maschinellen Lernens, die darauf ausgelegt sind, neue Datenmuster zu generieren, die einem bestimmten Datensatz ähneln. GANs bestehen aus zwei neuronalen Netzwerken, einem Generator und einem Diskriminator, die gleichzeitig in einer konkurrierenden Weise trainiert werden. Der Generator erzeugt synthetische Muster, während der Diskriminator die erzeugten Muster auswertet und sie von echten Daten unterscheidet.

Der Generator verbessert kontinuierlich seine Datengenerierungsfähigkeiten, indem er versucht, den Diskriminator zu täuschen, der wiederum seine Fähigkeit verfeinert, echte von generierten Proben zu unterscheiden. Dieser kontradiktorische Prozess wird so lange fortgesetzt, bis die generierten Muster kaum noch von den echten Daten zu unterscheiden sind. Dadurch sind GANs besonders nützlich für Anwendungen wie Bildsynthese, Datenerweiterung und Stilübertragung.

Variationale Autoencoder (VAEs) sind eine Art generatives Modell, das lernt, komplexe Datenverteilungen zu repräsentieren, indem es die Eingabedaten in einen niedriger-dimensionalen latenten Raum kodiert und dann die Daten aus dieser komprimierten Darstellung rekonstruiert. VAEs bestehen aus zwei neuronalen Netzwerken: einem Encoder, der die Eingabedaten auf eine Wahrscheinlichkeitsverteilung im latenten Raum abbildet, und einem Decoder, der die Daten aus Stichprobenpunkten dieser Verteilung rekonstruiert.

Das VAE-Modell wird trainiert, um den Rekonstruktionsfehler und einen Regularisierungsterm zu minimieren, der die gelernte Verteilung dazu anregt, sich an eine vordefinierte vorherige Verteilung anzupassen. VAEs sind in der Lage, neue Datenproben zu erzeugen, indem sie zufällige Punkte aus dem latenten Raum dekodieren. Dadurch eignen sie sich für Anwendungen wie Bilderzeugung, Datenentrauschung und Repräsentationslernen.