- 1. Cloud Native Erklärt

- 2. Geschichte von Cloud Native

- 3. Was sind Cloud-native Anwendungen?

- 4. Was ist eine Cloud-native Architektur?

- 5. Was ist Cloud-native Anwendungsentwicklung?

- 6. Vorteile der Cloud-nativen Anwendungsentwicklung

- 7. Was ist ein Cloud-nativer Stack?

- 8. Cloud-native Sicherheitsherausforderungen

- 9. Cloud-Native FAQs

- Cloud Native Erklärt

- Geschichte von Cloud Native

- Was sind Cloud-native Anwendungen?

- Was ist eine Cloud-native Architektur?

- Was ist Cloud-native Anwendungsentwicklung?

- Vorteile der Cloud-nativen Anwendungsentwicklung

- Was ist ein Cloud-nativer Stack?

- Cloud-native Sicherheitsherausforderungen

- Cloud-Native FAQs

Was ist Cloud Native?

- Cloud Native Erklärt

- Geschichte von Cloud Native

- Was sind Cloud-native Anwendungen?

- Was ist eine Cloud-native Architektur?

- Was ist Cloud-native Anwendungsentwicklung?

- Vorteile der Cloud-nativen Anwendungsentwicklung

- Was ist ein Cloud-nativer Stack?

- Cloud-native Sicherheitsherausforderungen

- Cloud-Native FAQs

Cloudnativ ist ein Ansatz zur Anwendungsentwicklung, der Technologien wie Microservices, Container, Container-Orchestratoren und unveränderliche Infrastrukturen nutzt, um reaktionsfähige, skalierbare und fehlertolerante Softwareanwendungen in einer Cloud-Computing-Umgebung zu erstellen, bereitzustellen, auszuführen und zu verwalten.

Cloud Native Erklärt

Cloudnativ beschreibt das Design und den Betrieb von Softwareanwendungen, die für den Einsatz in der Cloud entwickelt wurden. Cloudnativ beschleunigt die digitale Transformation, weil es die Flexibilität, Skalierbarkeit und Ausfallsicherheit von Cloud-basierten Diensten maximiert, um effizient Anwendungen bereitzustellen, die einfach zu verwalten und zu pflegen sind.

Monolithische vs. Cloud-native Anwendungen: Ein Beispiel

Stellen Sie sich vor, eine Bank muss eine neue Anwendung erstellen. Vor dem Cloud-Computing musste die Bank Entwickler mit der Entwicklung der Anwendung beauftragen, die physische Infrastruktur kaufen, die für den Betrieb der Anwendung vor Ort erforderlich war, und diese Infrastruktur während der gesamten Lebensdauer der Anwendung warten. Um auf die App zuzugreifen, mussten die Benutzer eine Verbindung zu den Servern der Bank herstellen. Da auf diesen Servern jeder einzelne von der App angebotene Dienst gehostet wurde - Abfrage von Kontonummern, Überweisung von Geldern usw. - musste für die Aktualisierung und Wartung jedes einzelnen Dienstes das gesamte System heruntergefahren werden.

Als Entwickler begannen, Anwendungen in der Cloud zu hosten, haben sie ihre Anwendungen aus lokalen Umgebungen "gehoben und verschoben" und dabei die Gesamtarchitektur ihrer Anwendungen sowie deren Einschränkungen beibehalten. Anstatt Server zu kaufen und zu verwalten, um ihre Anwendungen zu hosten, mieteten sie Rechenressourcen von einem Cloud Service Provider (CSP). Aber neue Dienste wie Platform as a Service, Container as a Service und serverlose Infrastrukturhaben neue Möglichkeiten eröffnet, Anwendungen in halsbrecherischer Geschwindigkeit zu erstellen, bereitzustellen und zu verwalten - relativ gesehen.

Geschichte von Cloud Native

Die Praxis, Anwendungen vor Ort zu entwickeln, begann sich in den frühen 2000er Jahren mit dem Aufkommen der Virtualisierung und dem Aufkommen von Infrastructure as a Service (IaaS) -Anbietern wie Amazon Web Services (AWS) zu verändern, die es Entwicklern ermöglichten, virtuelle Maschinen in der Cloud zu provisionieren und zu verwalten. Dies ebnete den Weg für die Entwicklung von Plattform-as-a-Service (PaaS) -Angeboten wie Google App Engine und Heroku, die eine übergeordnete Abstraktionsebene für die Entwicklung und Bereitstellung von Cloud-basierten Anwendungen bereitstellten.

Den frühen Plattformen mangelte es jedoch an Flexibilität, und die Entwickler waren auf proprietäre APIs und Tools angewiesen. Als Reaktion darauf entstand ein neuer Ansatz, der sich auf die Entwicklung von Anwendungen konzentriert, die für die Cloud konzipiert sind und Open-Source-Technologien nutzen.

Ein frühes Beispiel für diesen Ansatz war die Twelve-Factor App-Methode, die aus einer Reihe von Prinzipien für den Aufbau von Cloud-nativen Anwendungen besteht, die auf Portabilität, Skalierbarkeit und Ausfallsicherheit ausgelegt sind. Zu diesen Grundsätzen gehören die Verwendung von deklarativen Formaten für die Konfiguration, die Verwendung zustandsloser Prozesse und die Behandlung von Backing-Diensten als angehängte Ressourcen.

Etwa zur gleichen Zeit entwickelte sich die Docker-Containertechnologie zu einem wichtigen Baustein für Cloud-native Anwendungen. Docker ermöglichte es Entwicklern, ihre Anwendungen und Abhängigkeiten in leichtgewichtige Container zu packen, die problemlos in verschiedenen Cloud-Umgebungen bereitgestellt werden konnten, und löste damit das Problem der Portabilität von Anwendungen.

Im Jahr 2014 veröffentlichte Google Kubernetes, eine Open-Source-Plattform für die Container-Orchestrierung. Kubernetes - ein leistungsstarkes Paket von Tools zur Automatisierung der Bereitstellung, Skalierung und Verwaltung von containerisierten Anwendungen - wurde zum Standard für die Verwaltung von containerisierten Anwendungen in der Cloud.

In den folgenden Jahren wurde der Cloud-native Ansatz für die Entwicklung von Anwendungen von Organisationen aus allen Branchen, von Startups bis hin zu Großunternehmen, übernommen und hat zur Entwicklung eines Ökosystems von Open-Source-Technologien, -Tools und -Plattformen geführt.

Was sind Cloud-native Anwendungen?

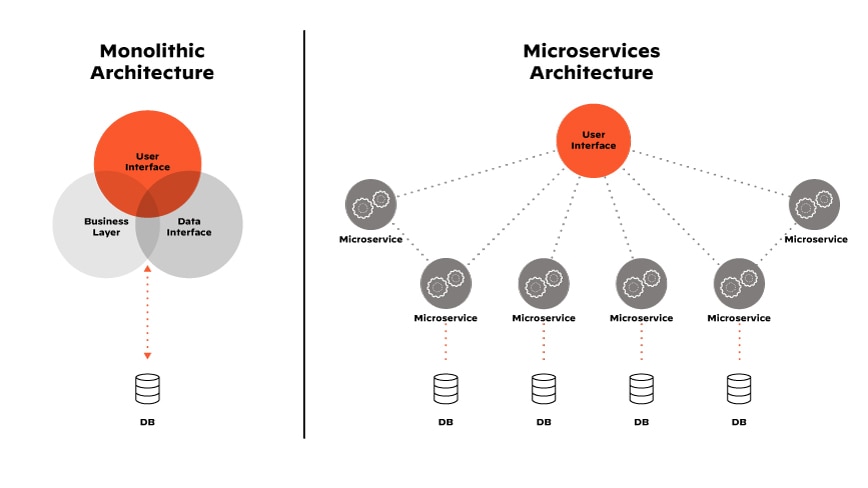

Grundsätzlich handelt es sich bei Cloud-nativen Anwendungen um Softwareprogramme, bei denen die Funktionalität in Microservices aufgeteilt ist - kleine, lose gekoppelte Dienste, die unabhängig voneinander arbeiten. Aufgrund dieser modularen Struktur sind Cloud-native Anwendungen einfacher zu erstellen und zu ändern als traditionelle monolithische Anwendungen. Entwickler können neue Funktionen und Updates für eine Anwendung bereitstellen, ohne das System zu unterbrechen.

Im Vergleich dazu werden monolithische Anwendungen als eine einzige Codebasis erstellt, wobei alle Komponenten eng miteinander verbunden sind und auf einem einzigen Server oder Rechner laufen. Das bedeutet, dass bei Änderungen oder Aktualisierungen der Anwendung die gesamte Anwendung neu kompiliert und bereitgestellt werden muss.

Weitere Technologien und Methoden, die für Cloud-native Anwendungen charakteristisch sind, sind:

- Container-basierte Infrastruktur, typischerweise Linux-Container mit Kubernetes-basierter Orchestrierung

- Architektur, die auf lose gekoppelten Microservices basiert

- Agile Entwicklung im DevOps-Stil

- Einsatz von kontinuierlicher Integration und kontinuierlicher Bereitstellung (CI/CD)

- Verwendung von Open-Source-Code und -Bibliotheken

- Serverlose Funktionen und PaaS

Was ist eine Cloud-native Architektur?

Die Cloud-native Architektur ist eine Design-Methode, die schnelle, wendige Techniken zur Anwendungsentwicklung unterstützt, um Cloud-native Anwendungen in Form von kleineren, zusammensetzbaren Teilen zu erstellen, die einfach zu warten, zu ändern, zu skalieren und zu migrieren sind. Es folgen die Komponenten der Cloud-nativen Architektur.

Unveränderliche Infrastruktur

Eine unveränderliche Infrastruktur ist ein Paradigma, bei dem Server und virtuelle Maschinen (VMs) eher ersetzt als ausgetauscht werden, wenn etwas aktualisiert, repariert oder geändert werden muss. Wenn eine Änderung vorgenommen werden muss, werden neue Komponenten, die diese Änderungen beinhalten, aus einem gemeinsamen Image erstellt und die alten aus der Produktion genommen. Dieser Ansatz schafft einen vorhersehbaren Prozess für die Bereitstellung von Cloud-nativen Lösungen.

Microservices Architektur

Der Aufstieg der Cloudnativen wurde durch die Microservices-Architektur vorangetrieben, ein Software-Designmuster, das die Verwendung von unabhängig bereitstellbaren Diensten betont, die jeweils eine bestimmte Geschäftsfunktion haben und in der Cloud-nativen Anwendung zusammenarbeiten. Microservices ermöglichen es Entwicklern, komplexe Anwendungen zu erstellen, indem sie kleinere, besser zu verwaltende Komponenten zusammenstellen, die unabhängig voneinander skaliert und aktualisiert werden können.

API

APIs sind ein Kommunikationsmittel, das in Cloud-nativen Anwendungen verwendet wird. Sie ermöglichen einen standardisierten, effektiven Informationstransfer zwischen unabhängigen Microservices, so dass diese Informationen gemeinsam nutzen können, um als ein zusammenhängendes Ganzes zu funktionieren.

Service Mesh

Ein Service Mesh ist eine Schicht in einer Cloud-nativen Architektur, die die Kommunikation zwischen Microservices verwaltet. Die Vernetzung von Diensten ermöglicht es auch, Verkehrsmanagement, Sicherheit und zusätzliche Funktionen zu Diensten hinzuzufügen, ohne neuen Code hinzufügen zu müssen.

Container

Mit Containern können Microservices mit ihren Abhängigkeiten - Code, Ressourcendateien, Systemtools und Systembibliotheken - in eigenständigen Umgebungen verpackt werden, so dass sie unter allen Umständen konsistent funktionieren. Dies ermöglicht es Entwicklern, einen Dienst einfach zu reproduzieren oder zu analysieren und zu isolieren. Da sie alles enthalten, was eine Anwendung zum Laufen braucht, ermöglichen Container die Bereitstellung von Cloud-nativen Anwendungen überall, entweder vor Ort oder in der Cloud.

Da jeder Microservice in einem Container bereitgestellt wird, arbeiten Gruppen von Containern als System oder "Stack" zusammen, um die komplette native Anwendung zu bilden. Ein dynamisches Orchestrierungssystem überwacht automatisch jeden Container und schaltet ihn je nach Bedarf des Benutzers ein und aus, was zu größerer Skalierbarkeit und Effizienz führt.

Was ist Cloud-native Anwendungsentwicklung?

Cloud-native Anwendungsentwicklung ist der Prozess der Erstellung stabiler, skalierbarer Anwendungen für den Betrieb in einer privaten, öffentlichen oder hybriden Cloud. Zu den gängigen Praktiken der Cloud-nativen Entwicklung gehören:

Kontinuierliche Integration

Bei der kontinuierlichen Integration (CI) werden Codeänderungen automatisch erstellt, getestet und in ein zentrales Repository integriert. So können Sie sicherstellen, dass Codeänderungen gründlich getestet und in die übrige Codebasis der Anwendung integriert werden. In der Cloud-nativen Entwicklung wird KI oft in Verbindung mit Containerisierung verwendet, die es Entwicklern ermöglicht, ihren Code, ihre Abhängigkeiten und ihre Konfiguration in eine einzige, in sich geschlossene Einheit zu packen.

Kontinuierliche Lieferung

Continuous Delivery (CD) ist der Prozess der Auslieferung von Anwendungen, die im CI-Prozess erstellt wurden , in eine produktionsähnliche Umgebung, wo sie zusätzlichen automatisierten Tests unterzogen werden, um unerwartete Leistungsprobleme zu beseitigen. Indem CD mehr inkrementelle Updates für Anwendungen in der Produktion ermöglicht, trägt es dazu bei, die Kosten, den Zeitaufwand und das Risiko für die Bereitstellung von Änderungen zu reduzieren. Außerdem können Entwickler schneller und häufiger hochwertige Software erstellen, testen und veröffentlichen. Bei der Cloud-nativen Entwicklung wird CD oft in Verbindung mit Automatisierungs- und DevOps-Praktiken eingesetzt, die dazu beitragen, den Prozess der Softwareentwicklung und -bereitstellung zu rationalisieren.

DevOps

DevOps ist ein Ansatz, der Softwareentwicklung und IT-Betrieb kombiniert, um die Effizienz, Geschwindigkeit, Qualität und Sicherheit der Softwareentwicklung und -bereitstellung zu erhöhen.

In der Cloud-nativen Entwicklung wird DevOps häufig eingesetzt, um viele Aspekte der Softwareentwicklung und -bereitstellung zu automatisieren. Der Fokus auf einen schnellen, iterativen Ansatz steht im Einklang mit dem Cloud-nativen Modell und hilft Organisationen, Anwendungen und Dienste mit hoher Geschwindigkeit bereitzustellen. So können Unternehmen ihren Kunden einen besseren Service bieten und in ihrer Branche effektiver konkurrieren.

Serverlos

Serverloses Computing in Verbindung mit Microservices ist ein Cloud-natives Entwicklungsmodell, das es Entwicklern ermöglicht, Code zu schreiben und bereitzustellen, ohne die zugrunde liegende Cloud-Infrastruktur verwalten zu müssen. Da die Ressourcen dynamisch und bedarfsgerecht zugewiesen werden, kann Serverless Computing die Kosten senken und die Skalierbarkeit verbessern.

Vorteile der Cloud-nativen Anwendungsentwicklung

Cloud-native Verfahren bieten die besten Möglichkeiten, die digitale Transformation und das Unternehmenswachstum voranzutreiben. Die Entwicklung nativer Anwendungen ist kosteneffizient und ermöglicht die einfache Aktualisierung und Wartung von Anwendungen durch kontinuierliche Integration/kontinuierliche Bereitstellung (CI/CD). Außerdem hilft es Organisationen, Silos in den Bereichen Entwicklung, Betrieb und Sicherheit aufzubrechen, um über den gesamten Lebenszyklus der Anwendungsentwicklung hinweg eine konsistente Erfahrung zu bieten.

Weitere Vorteile der Cloud-nativen Anwendungsentwicklung sind:

Erhöhte Geschwindigkeit

Cloud-native Anwendungen werden in einem agilen Entwicklungsprozess entwickelt, wobei die einzelnen Dienste unabhängig voneinander entwickelt und bereitgestellt werden. Dies ermöglicht eine schnellere Iteration und Bereitstellung neuer Funktionen oder Updates.

Verbesserte Qualität und Verlässlichkeit

Bei der Entwicklung von Cloud-nativen Anwendungen können sich die Entwickler auf die Bereitstellung von Mehrwert in der Anwendung konzentrieren, da der Cloud-Anbieter die zugrunde liegende Infrastruktur verwaltet. Dies verbessert auch die Konsistenz und Zuverlässigkeit der Betriebsumgebung.

Kosteneffiziente Operationen

Cloud-native Anwendungen sind so konzipiert, dass sie horizontal skalierbar sind, d.h. Ressourcen können je nach Bedarf dynamisch hinzugefügt oder entfernt werden. Umgekehrt werden monolithische Anwendungen in der Regel vertikal skaliert, d.h. es werden zusätzliche Ressourcen zum Server oder Rechner hinzugefügt, um eine erhöhte Nachfrage zu bewältigen. Dieser Ansatz kann teuer und ineffizient sein, da er häufig eine übermäßige Provisionierung von Ressourcen erfordert, um Nachfragespitzen zu bewältigen.

Bessere Anpassungsfähigkeit und Skalierbarkeit

Die Entwicklung von Cloud-nativen Anwendungen macht es einfach, mit den sich ändernden Anforderungen der Kunden und des Unternehmens Schritt zu halten, denn sie liefert Anwendungen aus lose gekoppelten Microservices, die sich leicht aktualisieren, ändern und in Echtzeit skalieren lassen.

Erhöhte Widerstandsfähigkeit

Die Entwicklung Cloud-nativer Anwendungen verbessert die Ausfallsicherheit, da sie Microservices verwendet, die isoliert werden können. Wenn eine Komponente einer monolithischen Anwendung ausfällt, kann dies das gesamte System zum Absturz bringen. Aber fehlertolerante, Cloud-native Anwendungen sind so konzipiert, dass sie auch dann noch funktionieren, wenn einzelne Dienste ausfallen.

Minimiertes Risiko eines Vendor Lock-In

Da bei der Entwicklung Cloud-nativer Anwendungen Container verwendet werden, um Microservices zwischen den Infrastrukturen verschiedener Anbieter zu übertragen, sind Organisationen nicht an einen bestimmten Anbieter gebunden. Sie können die Dienste mehrerer Cloud-Anbieter nutzen und die für ihr Unternehmen am besten geeigneten Optionen auswählen.

Vereinfachte Fehlersuche

Die Entwicklung von Cloud-nativen Anwendungen vereinfacht die Fehlerbehebung, da die Microservices-Architektur es leicht macht, Probleme bis zum Ursprungsdienst zurückzuverfolgen und das Problem ohne Serverausfallzeiten zu beheben.

Reduzierte Angriffsfläche

Cloud-native Anwendungen sind auf Sicherheit ausgelegt, wobei die einzelnen Dienste in der Regel voneinander isoliert sind. Dadurch verringert sich die Angriffsfläche für herkömmliche monolithische Anwendungen, die aus eng gekoppelten Komponenten bestehen, die es Angreifern leichter machen, auf sensible Daten zuzugreifen.

Was ist ein Cloud-nativer Stack?

Cloud-native Stack bezieht sich auf die Schichten von Tools und Technologien, die Entwickler verwenden, um Cloud-native Anwendungen zu erstellen, zu verwalten und auszuführen. Zu den Schichten des Cloud-nativen Stapels gehören:

Infrastruktur-Ebene

Die Infrastrukturebene bildet die Grundlage des Cloud-nativen Stacks. Es besteht aus den unterstützenden Komponenten der Cloud-nativen Anwendungsentwicklung, einschließlich Betriebssystemen, Speicher, Netzwerk und anderen Rechenressourcen. Die Infrastrukturebene wird von externen Cloud-Anbietern verwaltet.

Provisionierung Schicht

Die Provisionierungsschicht im Cloud-nativen Stack besteht aus den Tools, die zur Erstellung und Sicherung der Infrastruktur verwendet werden. Dazu gehören Tools zum Scannen und Speichern von Container-Images und zur Festlegung und Durchsetzung von Richtlinien.

Laufzeitschicht

Die Laufzeitschicht umfasst alles, was ein Container braucht, um in einer Cloud-nativen Umgebung zu laufen. Dazu gehören der Code, der zum Starten eines Containers verwendet wird, und die Tools, die Containern persistenten Speicher zur Verfügung stellen.

Orchestrierung und Verwaltungsschicht

Die Orchestrierungs- und Verwaltungsschicht ist ähnlich wie ein Betriebssystem dafür verantwortlich, die Cloud-Komponenten so zusammenzuführen, dass sie als eine einzige, zusammenhängende Einheit arbeiten können. Orchestrierungswerkzeuge wie Kubernetes, Docker und OpenShift ermöglichen es Entwicklern, containerisierte Anwendungen bereitzustellen, zu verwalten und zu skalieren.

Anwendungsdefinition und Entwicklungsschicht

Die Anwendungsdefinitions- und Entwicklungsschicht besteht aus allen Technologien, die Entwickler zur Erstellung von Anwendungen verwenden, einschließlich Datenbanken, Messaging-Systeme, Container-Images und CI/CD-Pipelines.

Beobachtbarkeit und Analysetools

Beobachtbarkeits- und Analysetools beobachten alle Schichten im Cloud-nativen Stack, um den Zustand von Cloud-Anwendungen zu überwachen und zu bewerten und sicherzustellen, dass die Servicequalität der Anwendung nicht beeinträchtigt wird. Sie sind in die Kategorien Protokollierung, Überwachung und Nachverfolgung unterteilt und werden zur Überwachung von Metriken wie CPU-Auslastung, Latenz und Speicher verwendet.

Cloud-native Sicherheitsherausforderungen

Da Cloud- und Cloud-native Umgebungen unterschiedliche Architekturen haben, die sich auf unterschiedliche Technologien stützen, unterscheiden sich Cloud-Sicherheit und Cloud-native Sicherheit. Cloud-Sicherheit erfordert einen umfassenden, ganzheitlichen Sicherheitsansatz, da sie eine Reihe von Assets und Anwendungen umfasst. Cloud-native Sicherheithingegen erfordert einen speziellen Ansatz, der die besonderen Sicherheitsanforderungen von Cloud-nativen Anwendungen und Infrastrukturen berücksichtigt.

Zu den üblichen Herausforderungen der Cloud-nativen Sicherheit gehören:

Mangelnde Sichtbarkeit: Die Komplexität der Cloud-Umgebung erschwert eine vollständige Transparenz und schafft blinde Flecken, in denen Sicherheitsrisiken schlummern können.

Vielfältige Bedrohungen: Cloud-Bedrohungsakteure finden kreative Angriffswege und Umgehungsmöglichkeiten für Sicherheitslösungen so schnell, wie sie geschaffen werden.

Unfähigkeit, konsistente Richtlinien durchzusetzen: Die Cloud-native Infrastruktur einer Organisation umfasst in der Regel mehrere Cloud-Service-Anbieter und unterschiedliche Sicherheitstools, so dass es schwierig ist, Sicherheitsrichtlinien zu zentralisieren und einheitlich anzuwenden.

Fehlkonfigurationen: Ein historisch bedingter Mangel an in den Anwendungsentwicklungsprozess integrierter Sicherheit lässt Raum für Fehlkonfigurationen und Schwachstellen im Open-Source-Code, die zur Offenlegung von Daten und zum unbefugten Workload -Zugriff führen können.

Langsame Sicherheitsprozesse: Die Aufrechterhaltung der wachsamen Compliance und Sicherheit, die für CI/CD-Pipelines mit hoher Geschwindigkeit erforderlich sind, bremst die dem Cloud-Computing innewohnende Flexibilität, Agilität und Geschwindigkeit.

Unsichere Standardwerte: Viele Cloud-native Tools, die von CSPs bereitgestellt werden, bieten flexible Einstellungen, einschließlich unsicherer Standardeinstellungen, die zu Sicherheitsverletzungen führen können.

Schwachstellen in der Software-Lieferkette: Ungepatchte Sicherheitslücken in Open-Source-Software erhöhen die Anfälligkeit der Software-Lieferkette.

Mit den richtigen Werkzeugen können Sicherheitsteams die Herausforderungen der Cloud-nativen Sicherheit meistern. Eine cloudnative Plattform für den Anwendungsschutz (CNAPP) bietet kontinuierliche Transparenz in einem einzigen Dashboard sowie eine konsistente Durchsetzung von Sicherheitsrichtlinien in der gesamten Cloud-Umgebung.