Was ist ein Workload?

Ein Workload ist eine Berechnungsaufgabe, ein Prozess oder eine Datentransaktion. Workloads umfassen die Rechenleistung, den Arbeitsspeicher, den Speicher und die Netzwerkressourcen, die für die Ausführung und Verwaltung von Anwendungen und Daten erforderlich sind. Im Rahmen der Cloud ist ein Workload ein Dienst, eine Funktion oder eine Anwendung, die Rechenleistung nutzt, die auf Cloud-Servern gehostet wird. Cloud-Workloads stützen sich auf Technologien wie virtuelle Maschinen (VMs), Container, Serverless, Microservices, Storage Buckets, Software as a Service (SaaS), Infrastructure as a Service (Iaas) und mehr.

Workloads Erklärt

Ein Workload umfasst alle Aufgaben, die ein Computersystem oder eine Software verarbeitet. Diese Aufgaben können von der Ausführung einer kleinen Rechenoperation bis hin zur Verwaltung komplexer Datenanalysen oder der Ausführung intensiver geschäftskritischer Anwendungen reichen. Workloads definieren im Wesentlichen die Anforderungen an die IT-Ressourcen, zu denen Server, virtuelle Maschinen (VMs) und Container gehören.

Wir können Arbeitslasten auch auf der Anwendungsebene kategorisieren und dabei Vorgänge wie Datenverarbeitung, Datenbankverwaltung und Rendering-Aufgaben berücksichtigen. Der Umfang und die Art der Arbeitslasten können die Leistung eines Systems beeinflussen. In einigen Fällen kann die Intensität der Belastung ohne effektives Management zu Unterbrechungen oder Verlangsamungen des Systems führen.

Arten von Workloads

Jeder Workload-Typ hat seine eigenen Anforderungen an Rechen-, Speicher- und Netzwerk-Ressourcen.

- Compute-Workloads sind Anwendungen oder Dienste, die Rechenleistung und Speicher benötigen, um ihre Funktionen auszuführen. Dazu können VMs, Container und serverlose Funktionen gehören.

- Speicher-Workloads, wie Video-Streaming und Online-Spiele, erfordern eine hohe Netzwerk-Bandbreite und niedrige Latenzzeiten.

- Netzwerk-Workloads, wie Video-Streaming und Online-Spiele, erfordern eine hohe Netzwerk-Bandbreite und niedrige Latenzzeiten.

- Big-Data-Workloads erfordern die Verarbeitung und Analyse großer Datensätze, z.B. bei maschinellem Lernen (ML) und künstlicher Intelligenz.

- Web-Workloads sind Anwendungen oder Dienste, auf die über das Internet zugegriffen wird. Dazu gehören E-Commerce-Websites, Plattformen für soziale Medien und webbasierte Anwendungen.

- High-Performance Computing Workloads beziehen sich auf Dienste, die eine hohe Verarbeitungsleistung benötigen. Beispiele hierfür sind Wettermodelle und Finanzmodelle.

- Internet der Dinge (IoT)-Workloads erfordern die Verarbeitung und Analyse von Daten aus Sensoren und anderen Geräten, wie z.B. Smart Homes, Industrieautomation und vernetzte Fahrzeuge.

Arbeitsbelastungen damals und heute

In den Anfängen der gemeinsam genutzten Mainframe-Computer wurden die Arbeitslasten durch ihre Nutzung definiert. Transaktions-Workloads führten Aufträge einzeln aus, um die Datenintegrität zu gewährleisten, während Batch-Workloads einen Stapel von Befehlen oder Programmen darstellten, die ohne Benutzereingriff ausgeführt wurden. Echtzeit-Workloads verarbeiten eingehende Daten in Echtzeit.

Doch mit der zunehmenden Verbreitung der Cloud hat sich das Konzept der Workloads weiterentwickelt und sich von den traditionellen Rechenzentren vor Ort zu Cloud-basierten Umgebungen verlagert. Diese Transformation umfasst die Migration von Arbeitslasten in Cloud-Umgebungen mit Infrastructure as a Service (IaaS), Platform as a Service (PaaS) oder Software as a Service (SaaS).

Im Kontext des Cloud-Computing ist ein Workload heute eine cloud-native oder nicht-cloud-native Anwendung oder Fähigkeit, die auf einer Cloud-Ressource laufen kann. VMs, Datenbanken, Container, Hadoop-Knoten und Anwendungen werden alle als Cloud-Workloads betrachtet.

Das hybride Multicloud-Netzwerk ist wesentlich komplizierter als die alten Rechenzentren vor Ort. Organisationen müssen heute Containersicherheit und Integrität in privaten und öffentlichen Clouds gewährleisten, die oft von mehreren Cloud Service Providern (CSPs) gehostet werden. Aber Cloud-Dienste passen sich schwankenden Arbeitslasten an, ohne dass ein erhebliches Vorabkapital erforderlich ist, und erweisen sich als kosteneffizient.). But cloud services accommodate fluctuating workloads without the need for significant upfront capital and prove cost-effective.

Merkmale der Cloud-Arbeitslast

Cloud-Workloads weisen über gemeinsame Architekturen und Cloud-Infrastrukturen unterschiedliche Merkmale auf. Dazu gehören:

- Skalierbarkeit: Cloud-Workloads bieten die Möglichkeit, Ressourcen je nach Bedarf zu erhöhen oder zu verringern, was die Effizienz der Ressourcenverwaltung erhöht.

- Elastizität: Die Fähigkeit von Cloud-Workloads, sich durch autonome Provisionierung und Deprovisionierung von Ressourcen an Veränderungen anzupassen, ist für moderne Unternehmen von zentraler Bedeutung.

- Ressourcenpooling: Cloud-Workloads teilen sich einen Pool konfigurierbarer Computing-Ressourcen und fördern so eine effiziente Ressourcennutzung.

- Messbarer Service: Cloud-Systeme kontrollieren und optimieren automatisch die Ressourcennutzung, indem sie eine für die Art des Dienstes - ob IaaS, PaaS oder SaaS - geeignete Messfunktion anwenden.

- Auf Anfrage Selbstbedienung: Cloud-Benutzer können Provisionierung von Computing-Funktionen wie Serverzeit und Netzwerkspeicher ohne menschliche Interaktion mit den Dienstanbietern vornehmen.

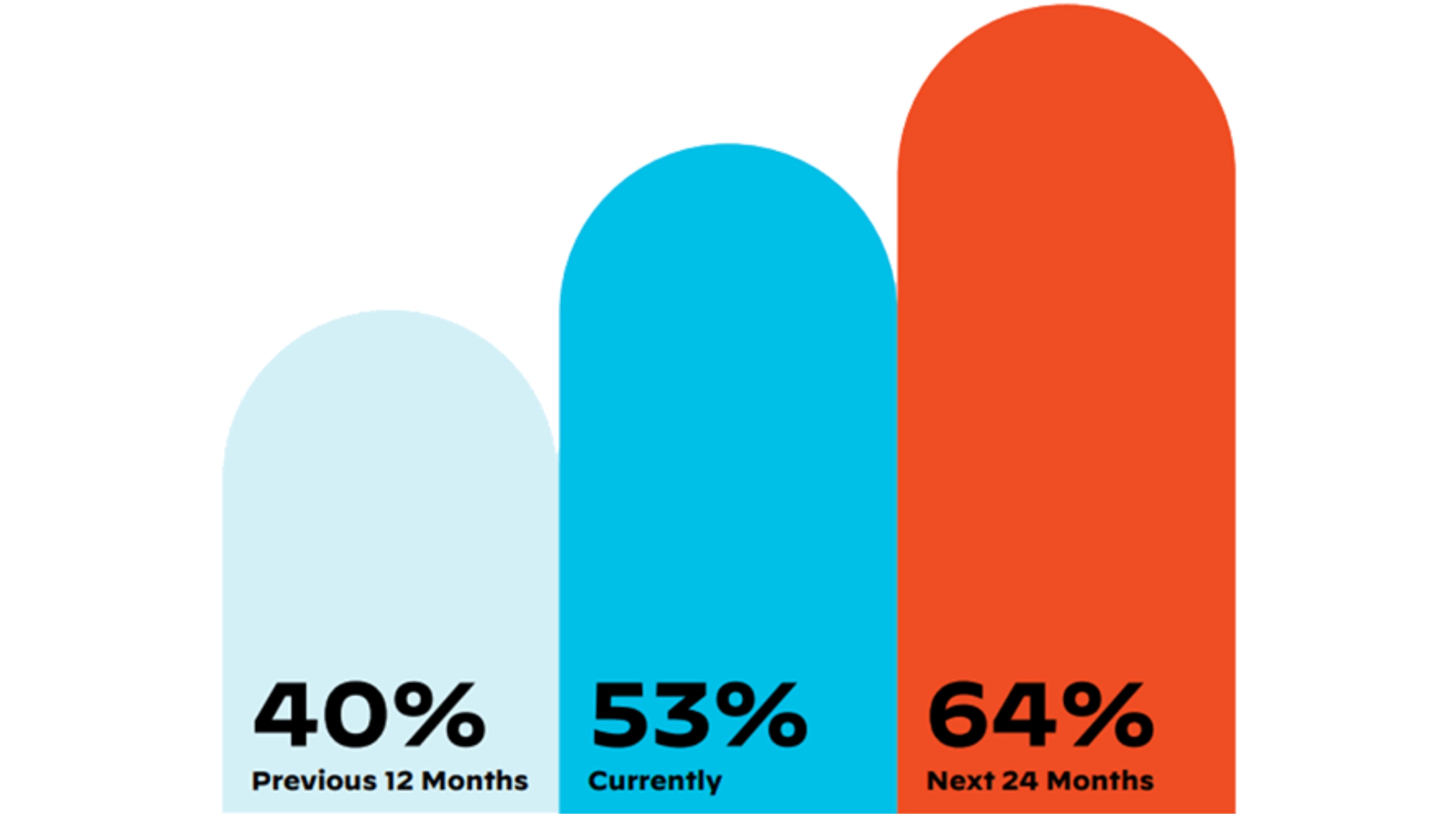

Abbildung 1: Prozentualer Anteil der Arbeitslasten, die dieses Jahr in die Cloud verlagert wurden, laut dem State of Cloud-Native Security Report

Cloud oder vor Ort?

Die Entscheidung, wo Workloads ausgeführt werden sollen, hängt von den Variablen ab, die für Ihre Organisation und Ihre Workloads spezifisch sind. Organisationen sollten die Optionen bewerten und dabei Leistung, Sicherheit, Compliance und Kosten berücksichtigen, um die beste Umgebung zu bestimmen.

Die Entscheidung, wo Workloads ausgeführt werden sollen, hängt von den Variablen ab, die für Ihre Organisation und Ihre Workloads spezifisch sind. Organisationen sollten die Optionen bewerten und dabei Leistung, Sicherheit, Compliance und Kosten berücksichtigen, um die beste Umgebung zu bestimmen.

Berücksichtigen Sie Sicherheit und Compliance, wenn Sie entscheiden, wo Sie Workloads ausführen. Bestimmte Arbeitslasten können durch Vorschriften auf lokale oder private Cloud-Umgebungen beschränkt werden. Die Kosten sind eine weitere Überlegung. Öffentliche Cloud-Dienste können eine flexible und kostengünstige Möglichkeit sein, Arbeitslasten zu betreiben, insbesondere solche mit variabler Nachfrage. Andere Arbeitslasten können sich jedoch als kostengünstiger erweisen, wenn sie vor Ort oder in einer privaten Cloud-Umgebung ausgeführt werden.

Bereitstellen von Workloads in der Cloud

Die Cloud bietet eine ideale Umgebung für eine Vielzahl von Workloads, wobei einige Workloads besonders gut für die Cloud geeignet sind.

- Web-Anwendungen: Cloud-Plattformen bieten die nötige Erweiterbarkeit und Verfügbarkeit, um große Mengen an Anfragen für Webanwendungen zu verarbeiten.

- Big-Data und Analytik: Cloud-Anbieter bieten Big Data- und Analysetools an, die bei der Verwaltung und Verarbeitung großer Datenmengen helfen.

- DevOps und CI/CD: Cloud-Plattformen können die Infrastruktur zur Unterstützung automatisierter Softwareentwicklungs-, Test- und Bereitstellungsprozesse bereitstellen.

- Disaster Recovery und Backup: Cloud-Plattformen können für Offsite-Backups von Daten und Systemen sowie für die Ausfallsicherung genutzt werden.

- Maschinelles Lernen und KI: Cloud-Anbieter bieten Tools für das Training von ML-Modellen und deren Skalierung in Produktionsumgebungen.

- IoT und Edge Computing: Cloud-Plattformen bieten Dienste zur Unterstützung von IoT-Geräten und Edge-Computing-Anwendungen, wie Datenverarbeitung, Speicherung und Analyse.

Aber die Cloud eignet sich nicht für alle Arbeitslasten. Organisationen sollten sich bei der Wahl ihrer Plattform auf eine Analyse der Anforderungen und Merkmale der einzelnen Arbeitslasten stützen.

Bereitstellung von Workloads vor Ort

Ein Beispiel für Details, die Sie bei der Entscheidung, welche Arbeitslasten vor Ort bereitgestellt werden sollen, berücksichtigen sollten:

- Sicherheitsanforderungen: Die Bereitstellung von Workloads vor Ort in stark regulierten Branchen kann die beste Option sein, um Datensicherheit und gesetzliche Compliance zu gewährleisten.

- Datenintensive Workloads: Workloads, die große Datenmengen verarbeiten und speichern, profitieren von der Bereitstellung vor Ort, da die Kosten für die Datenübertragung und die Speicherung in der Cloud hoch sind.

- Latenzempfindliche Workloads: Anwendungen, die eine niedrige Latenzzeit erfordern, wie z.B. Echtzeit-Datenverarbeitung oder Spiele, können von einer Bereitstellung vor Ort profitieren.

- Angepasste Workloads: Die Bereitstellung vor Ort, um die Kontrolle über die zugrunde liegende Infrastruktur zu gewährleisten, eignet sich besser für Anwendungen, die maßgeschneiderte Hardware benötigen.

- Kostenerwägungen: Die Ausführung von Workloads vor Ort kann aufgrund der Ressourcennutzung, der Speicheranforderungen und der Nutzungsmuster kosteneffizient sein.

Hybrid Cloud Bereitstellungen

Eine hybride Cloud ist eine Cloud-Umgebung, die eine lokale Infrastruktur mit Cloud-Diensten von einem oder mehreren privaten oder öffentlichen Cloud-Anbietern kombiniert. Mit dieser Art von Cloud-Architektur können Organisationen von den Angeboten sowohl der lokalen als auch der Cloud-Infrastruktur profitieren.

Mit einer hybriden Cloud können Organisationen Workloads in verschiedenen Umgebungen bereitstellen, um den Anforderungen der Anwendung oder des Workloads gerecht zu werden. Sie können sich dafür entscheiden, sensible Workloads vor Ort zu behalten, um gesetzliche Anforderungen zu erfüllen, und andere Workloads, die Skalierbarkeit und Flexibilität erfordern, in einer öffentlichen Cloud bereitzustellen.

Um eine hybride Cloud-Umgebung zu ermöglichen, müssen Organisationen über die notwendige Infrastruktur verfügen, z. B. über Netzwerke und Konnektivität zwischen der lokalen Infrastruktur und den Cloud-Diensten. Sie benötigen außerdem eine Cloud-Verwaltungsplattform, Automatisierungstools und Sicherheitslösungen, um Workloads über mehrere Umgebungen hinweg zu verwalten.

Cloud-gnostische Arbeitslasten

Viele Organisationen geben Cloud-agnostischen Strategien den Vorzug und bevorzugen die Freiheit einer Cloud-agnostischen Infrastruktur und App-Architektur und -Entwicklung. Workloads, die für die Ausführung auf einer beliebigen Cloud-Plattform konzipiert sind, bringen die Vorteile der Kompatibilität mit sich, die da wären:

- Vermeiden Sie Vendor Lock-in: Durch die Entwicklung von Cloud-agnostischen Anwendungen können Organisationen den Cloud-Anbieter wechseln, ohne dass eine kostspielige Überarbeitung der Workloads und Technologie-Stacks erforderlich ist.

- Portabilität: Cloud-agnostische Workloads können auf jeder Cloud-Plattform bereitgestellt werden, was für mehr Flexibilität und Agilität sorgt.

- Kosteneinsparungen: Die Möglichkeit, Workloads auf der Plattform bereitzustellen, die die kostengünstigsten Ressourcen bietet, ermöglicht es Organisationen, Kostenschwankungen auszunutzen oder Spot-Instanzen zu verwenden.

- Vermeiden Sie einzelne Fehlerquellen: Organisationen können vermeiden, sich bei kritischen Anwendungen auf einen einzigen Cloud-Anbieter zu verlassen, was das Risiko von Ausfallzeiten oder Datenverlusten verringert.

Um Cloud-agnostische Arbeitslasten zu ermöglichen, verwenden Organisationen in der Regel Standardtechnologien und Schnittstellen, die von mehreren Cloud-Anbietern unterstützt werden, wie z.B. Kubernetes für die Container-Orchestrierung und Terraform für Infrastructure as Code.

Video: Wie Sicherheitsingenieure und App-Entwickler einen effektiven Sicherheitsprozess schaffen können

Workload Management

Workload-Management bezieht sich auf den endlosen Zyklus der Überwachung, Kontrolle und Zuweisung von Ressourcen zu Workloads. Die Verantwortung umfasst die unzähligen Prozesse, die zur Optimierung und zum Ausgleich der Verteilung von Computerressourcen erforderlich sind, um sicherzustellen, dass die Arbeitslasten mit minimalen Unterbrechungen oder Ausfallzeiten ausgeführt werden.

In einer Cloud-Umgebung ist das Workload-Management von entscheidender Bedeutung, da sich mehrere Benutzer und Anwendungen Ressourcen teilen. Der Workload-Manager muss sicherstellen, dass jeder Workload Zugriff auf die Ressourcen hat, die er benötigt - und zwar ohne die Leistung anderer Workloads zu beeinträchtigen.

Die Verwaltung von Workloads kann in Multi-Cloud-Umgebungen, in denen die Workloads auf mehrere Cloud-Plattformen verteilt sind, besonders komplex werden. Ein effektives Multicloud-Workload-Management erfordert ein klares Verständnis der Fähigkeiten der einzelnen Cloud-Plattformen und der spezifischen Anforderungen der einzelnen Workloads.

Ressourcen-Zuweisung

Bei der Verwaltung von Workloads geht es um die Zuweisung von Computerressourcen wie CPU, Arbeitsspeicher und Storage an verschiedene Workloads auf der Grundlage ihrer Bedürfnisse und Prioritäten. Eine effektive Zuweisung erfordert die Überwachung der Ressourcennutzung, die Vorhersage des zukünftigen Bedarfs und die Anpassung der Ressourcenzuweisung nach Bedarf.

Lastausgleich

Zum Workload-Management gehört auch der Lastausgleich oder die Verteilung von Workloads auf mehrere Computerressourcen, um die Ressourcenauslastung zu optimieren und Engpässe zu vermeiden. Organisationen verlassen sich in der Regel auf Techniken wie Round-Robin, Least Connections und IP-Hash, um eine gleichmäßige Auslastung zu erreichen.

Priorisierung der Arbeitsbelastung

Um Workloads zu verwalten, müssen DevOps-Teams ihre Workloads auf der Grundlage von Kritikalität, Leistungsanforderungen und Service Level Agreements priorisieren. Die richtige Priorisierung stellt sicher, dass geschäftskritische Workloads die erforderlichen Ressourcen erhalten, um optimal zu laufen, selbst bei Spitzenbedarf.

Überwachung und Optimierung

Die Überwachung der Leistung von Workloads und die Anpassung der Ressourcenzuweisung zur Optimierung der Leistung und Minimierung der Kosten ist ein zentrales Element des Workload-Managements. Dies kann automatische Skalierung, Autotuning und andere Optimierungstechniken beinhalten.

Workload-Automatisierung

Die Workload-Automatisierung wird häufig von Unternehmen mit komplexen IT-Infrastrukturen eingesetzt und rationalisiert IT-Prozesse durch die Automatisierung der Planung, Ausführung und Überwachung von Workloads. Im Zuge der digitalen Transformation ist die Automatisierung von Arbeitsabläufen für einen funktionierenden IT-Betrieb unerlässlich geworden. Zu den Vorteilen der Workload-Automatisierung gehören:

Reduzierte Fehler

Durch die Automatisierung sich wiederholender und manueller Aufgaben entfällt die Notwendigkeit menschlichen Eingreifens, wodurch das Risiko von Fehlern und potenziellen negativen Ereignissen wie Datenverlusten verringert wird.

Verbesserte Effizienz

Durch die Automatisierung sich wiederholender und zeitaufwändiger Aufgaben können sich die Teams auf wichtige Aufgaben konzentrieren. Anstatt Protokolle manuell nach Fehlern zu durchsuchen, kann die Workload-Automatisierung beispielsweise Fehler erkennen und die IT-Mitarbeiter darauf aufmerksam machen, so dass sie sich auf die Lösung von Problemen konzentrieren können, anstatt Protokolle zu überwachen.

Optimierte Ressourcenauslastung

Die Workload-Automatisierung kann die Ressourcennutzung optimieren, indem sie dafür sorgt, dass Aufgaben und Prozesse zu optimalen Zeiten geplant und ausgeführt werden. Indem sie ressourcenintensive Aufgaben beispielsweise so planen, dass sie außerhalb der Hauptgeschäftszeiten ausgeführt werden, verringern die Teams das Potenzial für Ressourcenkonflikte.

Erhöhte Agilität

Durch die Automatisierung der Provisionierung und Bereitstellung von Anwendungen und Diensten reduziert die Workload-Automatisierung den Zeit- und Arbeitsaufwand für die Bereitstellung neuer Dienste. So können IT-Teams schneller und effizienter auf geschäftliche Anforderungen reagieren.

Verbesserte Compliance

Durch die konsistente und überprüfbare Ausführung von IT-Prozessen durch Workload-Automatisierung stärken Organisationen die Einhaltung gesetzlicher Standards und verringern letztlich das Risiko von Compliance-Verstößen.

Reduzierte Kosten

Durch den Wegfall sich wiederholender und manueller Aufgaben optimiert die Workload-Automatisierung nicht nur die Ressourcennutzung und reduziert den Bedarf an zusätzlichen Hardware- und Software-Ressourcen. Außerdem werden die Kosten für den IT-Betrieb gesenkt, so dass sich die IT-Mitarbeiter auf höherwertige Aufgaben konzentrieren können.

Die auf dem Markt erhältlichen Tools zur Workload-Automatisierung reichen von Open-Source-Lösungen (z.B. Jenkins und Ansible) bis hin zu unternehmenstauglichen Plattformen (z.B. BMC Control-M und IBM Workload Automation). Diese Tools bieten in der Regel eine Reihe von Merkmalen und Funktionen, wie z.B. Auftragsplanung, ereignisgesteuerte Automatisierung, Workload-Überwachung und -Berichterstellung sowie die Integration mit anderen IT-Systemen und -Anwendungen.

Cloud Workload Schutz

Die Migration von Workloads in die Cloud bietet Organisationen zahlreiche Vorteile, stellt sie aber auch vor Sicherheitsherausforderungen. Die Angriffsfläche erweitert sich in der Cloud. Selbst wenn Sicherheitskontrollen vorhanden sind, kann eine Zero-Day-Schwachstelle oder ein falsch konfigurierter Server- oder Storage-Bucket ein erhebliches Risiko für Workloads darstellen.

Sicherheitsstrategien für Cloud-Workloads können zur Sicherheit Ihrer Organisation beitragen.

- Implementieren Sie Zugriffsmanagement-Kontrollen: Die Implementierung einer Last-Privileged-Zugriff -Richtlinie kann den potenziellen Schaden einer Sicherheitsverletzung begrenzen.

- Sicherheitskontrollen automatisieren: Automatisierung kann sicherstellen, dass Sicherheitskontrollen konsistent auf alle Workloads angewendet werden - und die Reaktionszeiten im Falle eines Sicherheitsvorfalls verkürzen.

- Überwachen und Verwalten von Schwachstellen: Regelmäßiges Scannen nach Schwachstellen und die unverzügliche Anwendung von Patches sind entscheidend für den Schutz von Cloud-Workloads.

- Sichere Container und serverlose Workloads: Scannen Sie Container-Images auf Schwachstellen und implementieren Sie geeignete Isolierungsrichtlinien für serverlose Funktionen.

- Verschlüsseln Sie sensible Daten: Datenverschlüsselung kann sensible Daten auch dann schützen, wenn andere Sicherheitskontrollen versagen. Denken Sie daran, Daten im Ruhezustand und bei der Übertragung zu verschlüsseln.

Implementierung eines CWPP

Die auf Skalierbarkeit ausgelegte Cloud Workload Protection Platform (CWPP) kann sich anpassen, um eine wachsende Anzahl von Workloads zu schützen und bietet konsistente Sicherheit unabhängig von der Größe der Cloud-Umgebung. CWPPs sind Workload-zentriert, d.h. sie schützen den Workload unabhängig davon, wo er sich befindet - vor Ort, in der Cloud oder in einer hybriden Umgebung. Angesichts der Tatsache, dass Workloads schnell zwischen Plattformen und Infrastrukturen wechseln, ist diese Art von Workload-Schutz unerlässlich.

CWPPs bieten Organisationen eine dringend benötigte Plattform-Alternative zum Tool-Wirrwarr. Sie lösen Probleme mit der Komplexität und maximieren gleichzeitig die Sicherheit mit zentraler Sichtbarkeit und Kontrolle, Schwachstellenmanagement, Zugriffsmanagement, Malware-Schutz und mehr.